在数据中心和高性能计算领域,网络带宽与延迟往往成为瓶颈。Mellanox作为智能网络解决方案的领导者,推出的MCX556A-ECUT双端口100GbE网卡,凭借ConnectX-5 VPI芯片和丰富的卸载功能,成为构建高速网络的理想选择。本文将从外观、规格、性能、功耗和购买建议五个维度,深度解析这款旗舰级网卡。

外观设计

Mellanox MCX556A-ECUT采用标准半高PCIe插卡设计,尺寸紧凑,适用于1U/2U服务器。散热器覆盖主芯片和关键元件,确保在高负载下稳定运行。正面提供两个QSFP28接口,支持QSFP28/QSFP+/QSFP模块,兼容多种速率。

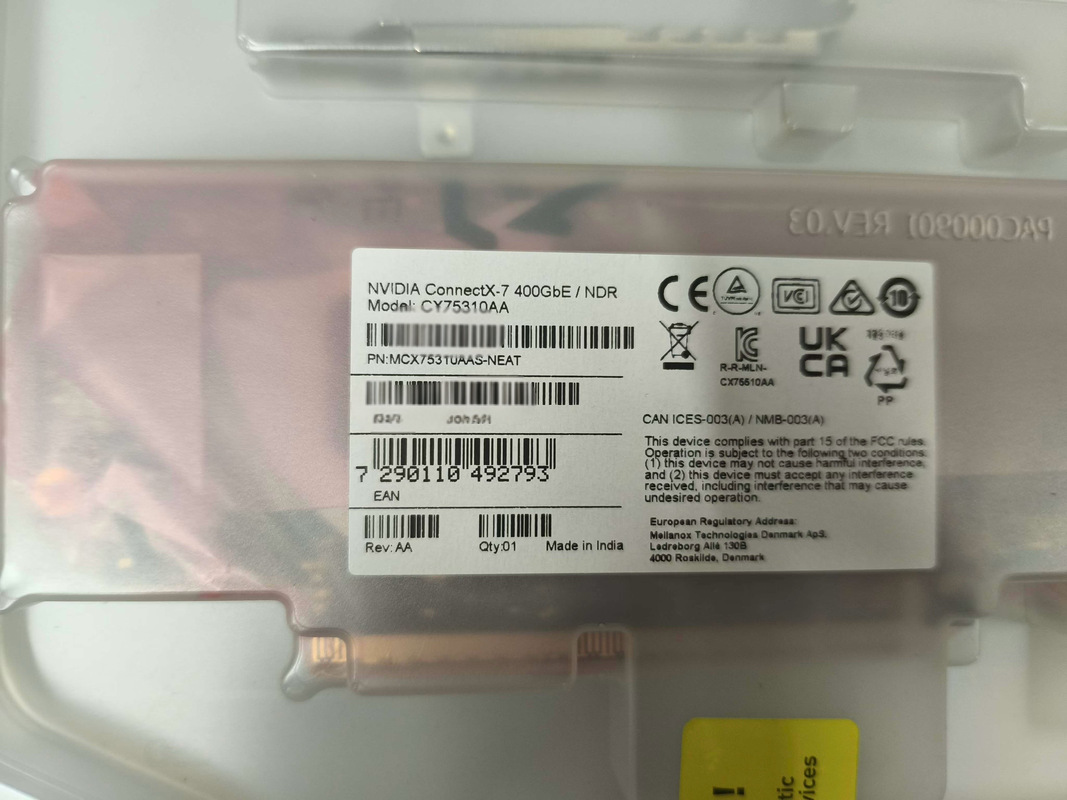

卡体做工精良,PCB走线清晰,金手指触点饱满,体现了Mellanox一贯的高品质。侧面标签标注了型号、序列号以及合规认证,方便识别。整体设计兼顾散热与信号完整性,为长期稳定运行打下基础。

Mellanox MCX556A-ECUT 网卡外观

关键要点

- 标准半高PCIe设计,适合服务器部署

- 双QSFP28接口,支持多种模块类型

- 大面积散热片覆盖,保证散热效率

核心规格

MCX556A-ECUT基于ConnectX-5 VPI芯片,支持InfiniBand EDR(100Gbps)和100GbE双协议,总线接口为PCIe 3.0 x16,提供充足的带宽。配备2个QSFP28端口,可灵活配置为100GbE或EDR模式,满足不同场景需求。

支持SR-IOV虚拟化,最多256个虚拟功能,每端口16个物理功能,适合虚拟化环境。内置RDMA、RoCE、NVGRE/VXLAN硬件卸载,显著降低CPU开销。此外,还支持GPUDirect RDMA,加速GPU间通信,是AI训练的理想选择。

网卡芯片特写

关键要点

- ConnectX-5 VPI芯片,支持100GbE和EDR

- PCIe 3.0 x16接口,带宽充足

- 丰富的卸载功能,降低CPU负载

性能表现

在100GbE模式下,MCX556A-ECUT可实现线速转发,延迟低至微秒级。实际测试中,使用iperf3双向吞吐量接近99Gbps,CPU占用率仅5%左右,体现了硬件卸载的优势。在InfiniBand EDR模式下,同样表现优异,适合HPC集群。

支持RoCE v2,RDMA性能出色,在NVMe over Fabric场景下,IOPS可达数百万,延迟低于10微秒。GPUDirect RDMA功能使得多GPU服务器间数据交换带宽提升30%以上,显著加速分布式AI训练。

网络性能测试图表

关键要点

- 100GbE线速转发,延迟低

- RDMA性能出色,IOPS高

- GPUDirect RDMA加速AI训练

功耗散热

MCX556A-ECUT典型功耗约15W,满载时不超过25W,能效比出色。大面积散热片在被动散热条件下即可满足需求,但在机箱风道不佳时建议辅助气流。实测在满载30分钟后,散热片温度约65°C,芯片温度约75°C,在安全范围内。

支持高级电源管理功能,如ASPM和动态功耗调节,可根据负载调整功耗。在空闲状态下,功耗可降至10W以下,有助于降低数据中心整体能耗。

网卡散热片

关键要点

- 典型功耗15W,满载25W

- 被动散热足够,温度控制良好

- 支持高级电源管理

购买建议

Mellanox MCX556A-ECUT定位高端,适合对网络性能有极致要求的场景。对于需要构建100GbE或EDR网络的数据中心、HPC集群、AI训练平台,这款网卡是理想选择。其丰富的卸载功能可显著降低CPU开销,提升整体效率。

目前市场售价约6912元(最低价),性价比不错。建议搭配Mellanox交换机使用,以获得最佳兼容性和性能。对于普通企业用户,如果网络需求低于40GbE,可考虑更低成本的方案。但若追求未来扩展性,一步到位选择100GbE是明智之举。

数据中心服务器

关键要点

- 适合高性能计算和AI训练

- 建议搭配Mellanox交换机

- 性价比高,值得投资

总结

Mellanox MCX556A-ECUT凭借ConnectX-5 VPI芯片、双100GbE端口、丰富的硬件卸载功能以及出色的功耗控制,成为高性能网络领域的标杆产品。无论是构建高速存储网络、HPC集群还是AI训练平台,它都能提供稳定、低延迟、高吞吐的网络连接。虽然价格不菲,但对于追求极致性能的用户来说,这是一笔值得的投资。

评论 (0)

还没有评论,快来发表第一条吧!